摘要:随着人工智能时代的来临,机器人三大定律曾备受关注。如今这些定律的提及频率逐渐减少。原因在于,随着技术的不断进步,机器人技术日益复杂,三大定律的局限性逐渐显现。对于机器人伦理和安全的探讨也在不断深入,需要更为全面和细致的考虑。虽然三大定律仍是基础理念,但在实际应用中需要结合具体情况进行灵活调整。

目录导读:

随着人工智能(AI)技术的飞速发展,机器人技术也日新月异,呈现出前所未有的活力,与此同时,我们常常会发现,关于机器人三大定律的讨论似乎不再像过去那样频繁,这是否意味着这些定律已经过时,或者不再适用于现代AI技术的发展?本文将就此话题展开讨论。

背景概述

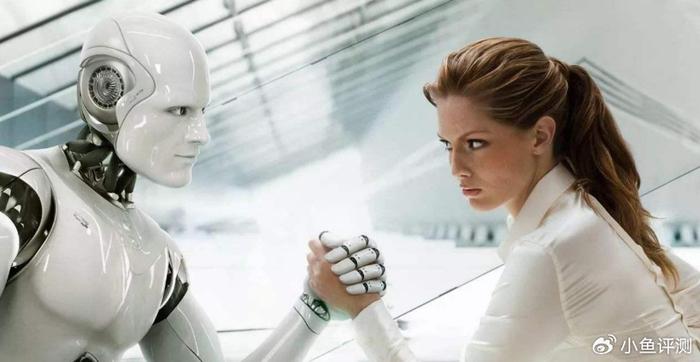

机器人三大定律,由科幻小说作家艾萨克·阿西莫夫提出,旨在确保机器人在与人类交互过程中遵循一定的道德原则,这三大定律分别是:机器人不得伤害人类,也不得因不采取行动而让人类受到伤害;机器人必须服从人类的命令,但前提是这些命令不与第一定律相冲突;机器人必须保护自身的存在,但不能违背第一、第二定律,随着AI技术的快速发展,这些定律的适用性和现实性逐渐受到质疑。

现代AI技术的发展

现代AI技术已经超越了单纯的机器人范畴,涵盖了机器学习、深度学习、自然语言处理等多个领域,随着算法和硬件的进步,AI系统已经能够在许多领域进行自主学习和决策,不再仅仅是执行预设指令的工具,这种技术进步使得机器人三大定律的适用性受到挑战。

复杂场景下的挑战

在现代社会,AI系统不仅应用于工业生产,还广泛应用于医疗、教育、金融等领域,在这些领域中,AI系统的决策可能会直接影响到人类的生命、财产和安全,在这种情况下,机器人三大定律是否仍然适用,如何确保AI系统的行为符合道德和法律标准,成为亟待解决的问题。

伦理和法律的空白

目前,关于AI技术的伦理和法律框架尚未完善,尽管一些国家和地区已经开始尝试制定相关法规,但仍然存在许多空白和争议,在这种情况下,机器人三大定律作为一种道德指引,虽然有其价值,但由于缺乏法律强制力,难以确保AI系统的实际行为符合这些原则。

行业内的观点分歧

关于机器人三大定律的提及频率下降,也与行业内的观点分歧有关,一些专家认为,随着AI技术的发展,我们需要更加灵活和适应性强的道德和法律框架来规范AI系统的行为,而另一些专家则认为,机器人三大定律仍然具有指导意义,应该继续将其作为AI技术发展的重要原则。

技术和伦理的协同发展

面对现代AI技术的挑战,我们需要更加综合的视角来审视机器人三大定律的适用性问题,技术的发展不应该仅仅追求效率和创新,还需要考虑到伦理和道德的因素,我们应该在技术发展的同时,加强伦理和法律的建设,以确保AI技术的健康发展。

未来展望

随着AI技术的不断进步,我们将面临更多的挑战和机遇,在这种情况下,我们需要继续探讨机器人三大定律的适用性问题,并根据实际情况进行调整和完善,我们还需要加强国际合作,共同制定更加完善的道德和法律框架,以确保AI技术的全球发展符合人类的价值观和利益。

虽然在AI发展快速的时代,机器人三大定律的提及频率可能有所下降,但这并不意味着这些定律不再重要,相反,我们应该更加重视这一问题,加强技术和伦理的协同发展,以确保AI技术的健康、安全和可持续发展。

呼吁行动

我们呼吁相关部门、企业和专家加强合作,共同研究和制定适应现代AI技术发展的道德和法律框架,我们也需要提高公众的意识和参与度,共同关注AI技术的发展和伦理问题,只有这样,我们才能确保AI技术为人类带来福祉,而不是灾难。

转载请注明来自浙江先合信息技术有限公司,本文标题:《AI时代下的机器人三大定律,为何不再频繁提及?》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号